La Inteligencia Artificial ha sido presentada como una infraestructura infinita: disponible bajo demanda, escalable y capaz de resolver desde eficiencias operativas hasta desafíos complejos de negocio. Bajo esa lógica, muchas empresas han diseñado estrategias asumiendo que su acceso a la IA será permanente, asequible y creciente. Pero esa premisa comienza a fracturarse.

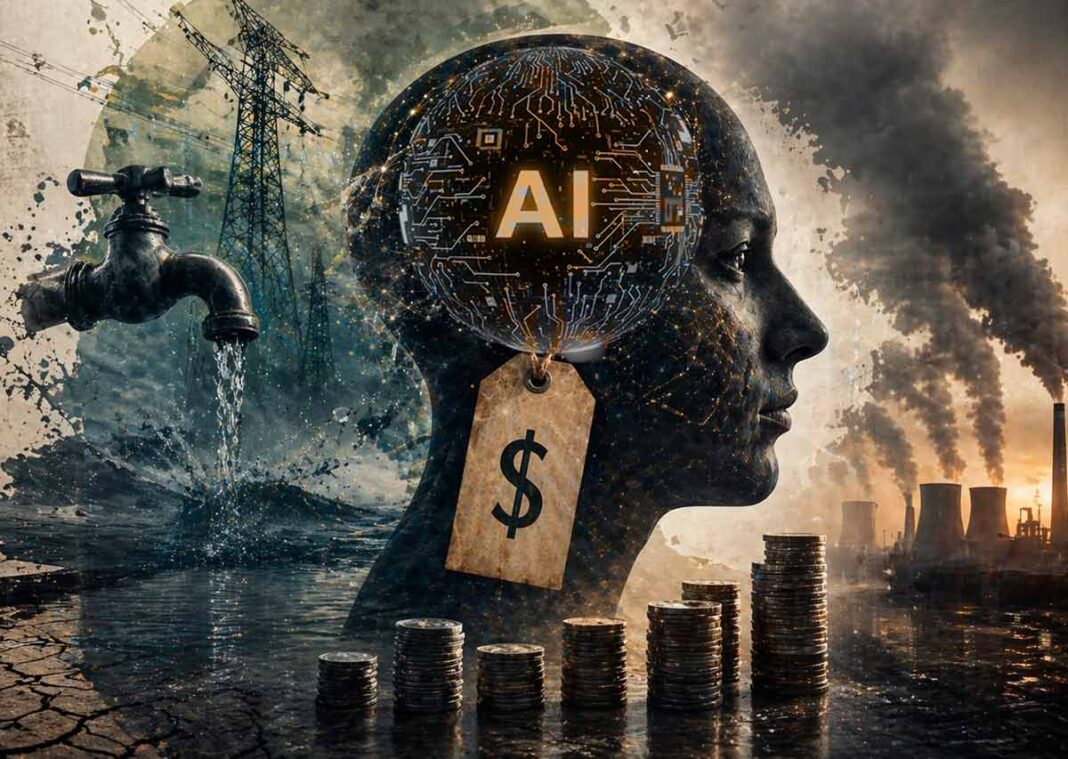

Hoy, en medio de tensiones energéticas, presión regulatoria, debates laborales y límites ambientales, emerge una pregunta incómoda: ¿qué pasa si la IA deja de ser abundante? En ese escenario, los riesgos ESG dejan de ser un marco reputacional para convertirse en un factor crítico de continuidad operativa. Y quizá, en esa intersección, se juegue una de las conversaciones más relevantes para el futuro empresarial.

Cuando la IA deja de parecer infinita

De acuerdo con Eco-Business, durante mucho tiempo, las empresas evaluaron la adopción tecnológica bajo una lógica de oportunidad, no de escasez. La IA era vista como una promesa de productividad, automatización y crecimiento, rara vez como un recurso vulnerable. Sin embargo, energía, agua, datos y legitimidad social son insumos finitos, y la IA depende de todos ellos.

Los líderes corporativos han aprendido a hacer pruebas de estrés para enfrentar crisis climáticas, interrupciones logísticas o shocks geopolíticos. Pero pocas organizaciones aplican esa misma disciplina a la Inteligencia Artificial. Ese vacío es llamativo, especialmente cuando la dependencia tecnológica crece más rápido que la preparación para gestionarla.

No se trata de cuestionar la adopción de IA, sino de asumir que su despliegue no ocurre en el vacío. Está condicionado por tensiones sociales, ambientales y políticas que pueden redefinir su acceso. Ahí es donde los riesgos ESG empiezan a marcar límites concretos.

Riesgos ESG: el trilema que puede redefinir el acceso a la IA

Hablar de IA responsable ya no se reduce a sesgos algorítmicos o ética digital. Hoy el debate pasa también por un trilema más amplio: impacto ambiental, desplazamiento laboral y aumento de desigualdades. Ignorar cualquiera de esos frentes podría traducirse en restricciones reales para operar.

Los centros de datos consumen enormes volúmenes de electricidad y agua; los proyectos enfrentan oposición social; sindicatos cuestionan automatizaciones que eliminan empleos; gobiernos comienzan a explorar controles más estrictos. Todo ello configura un entorno donde el acceso a la IA puede volverse más caro, más limitado o más político.

Lejos de ser variables periféricas, estos son riesgos ESG con potencial financiero y estratégico. Como ocurrió con el carbono, podrían pasar rápidamente de externalidades ignoradas a factores que transformen mercados enteros.

Tres escenarios para un futuro que ya no es lineal

Pensar en un solo futuro es, quizás, el mayor riesgo. Así como las empresas modelan distintos escenarios climáticos, hoy comienzan a emerger tres posibles futuros para la IA que exigen preparación.

El primero es el escenario base: IA abundante y asequible. Es el supuesto sobre el que operan muchas compañías. Pero también puede ser el más frágil si se sostiene sin cuestionamientos.

Un segundo escenario contempla una IA disponible, pero costosa. Aquí el cómputo se encarece, los recursos se tensionan y la IA empieza a comportarse como un activo premium. Grandes corporativos conservan acceso, mientras medianas y pequeñas empresas quedan rezagadas.

El tercer escenario es el más disruptivo: una IA racionada o soberana. Restricciones gubernamentales, fragmentación por geopolítica de datos o controles por seguridad nacional podrían convertirla en un recurso estratégico, no universal. Para muchas organizaciones, esto cambiaría por completo sus modelos operativos.

Productividad a costa de resiliencia

Existe una paradoja creciente: las empresas que más aceleran la integración de IA podrían ser también las más expuestas si su disponibilidad cambia. Optimizar todo para eficiencia puede debilitar la continuidad del negocio cuando las condiciones dejan de ser ideales.

Si los costos tecnológicos se disparan, las organizaciones que sustituyeron capacidades humanas por dependencia algorítmica podrían enfrentar un doble impacto: mayores costos y menor capacidad de adaptación. La productividad, sin resiliencia, puede convertirse en vulnerabilidad.

Este es un cambio profundo de enfoque. La conversación ya no es cuánto valor genera la IA, sino qué tan resistente es un negocio si ese valor se vuelve intermitente. Y ahí la planeación estratégica adquiere otra dimensión.

Riesgos ESG y la nueva licencia para operar

La licencia para operar ya no se define solo por cumplimiento normativo o reputación corporativa. También depende de cómo una empresa gestiona los efectos sociales y ambientales de tecnologías emergentes. Las organizaciones que incorporen desde ahora el trilema de la IA responsable podrán reducir costos, anticipar regulaciones y proteger legitimidad. No es solo prevención; es una ventaja competitiva.

Aquí los consejos de administración tienen un papel decisivo. Las preguntas cambian: ¿qué ocurre si se duplican los costos computacionales? ¿qué pasa si un proveedor estratégico deja de operar? ¿qué sucede si clientes y empleados perciben que la IA profundiza desigualdades?

Tratar estos desafíos como riesgos ESG estratégicos, y no como discusiones periféricas, puede marcar la diferencia entre liderar la transición o reaccionar tarde.

La cadena de suministro ahora también es algorítmica

Durante décadas, las empresas aprendieron a hacer debida diligencia sobre proveedores físicos. Hoy ese mismo rigor necesita extenderse a los proveedores de IA, modelos fundacionales, infraestructura digital y soberanía de datos.

La dependencia algorítmica también es una cadena de suministro, aunque muchas organizaciones aún no la tratan como tal. ¿Quién controla los modelos? ¿Dónde están los centros de cómputo? ¿Qué vulnerabilidades regulatorias existen? Son preguntas cada vez más materiales.

La resiliencia futura no dependerá solo de diversificar insumos tradicionales, sino también de entender que la infraestructura de IA puede sufrir interrupciones, restricciones o disputas geopolíticas. Ignorarlo sería repetir errores que otros riesgos sistémicos ya enseñaron.

Del entusiasmo tecnológico a la gobernanza estratégica

Quizá el mayor cambio no es tecnológico, sino cultural. Durante años, la conversación sobre IA ha estado dominada por innovación y velocidad. Ahora comienza a desplazarse hacia gobernanza, límites y responsabilidad.

Eso no implica frenar la adopción, sino madurarla. Las empresas que integren escenarios, resiliencia y gestión de impactos estarán mejor posicionadas para capturar beneficios sin comprometer continuidad ni legitimidad.

Porque el debate de fondo no es si la IA transformará los negocios. Eso ya ocurre. La pregunta es si las organizaciones están preparadas para un mundo donde ese acceso no sea ilimitado. Y en esa respuesta, los riesgos ESG podrían dejar de ser una advertencia para convertirse en una hoja de ruta.

La gran disrupción no sería que la Inteligencia Artificial avance más rápido de lo esperado, sino que las empresas sigan construyendo estrategias como si su acceso fuera un hecho garantizado. La historia de los negocios muestra que ningún recurso crítico es infinito cuando entran en juego presiones sociales, límites ambientales y regulación.

Mirar la IA como una variable estratégica de riesgo —como hoy se mira el clima, el agua o la cadena de suministro— no es una postura defensiva; es una decisión de largo plazo. Porque las compañías que entiendan esto no solo estarán preparadas para escenarios complejos, también ayudarán a definir una adopción tecnológica más sostenible. Y esa puede ser, al final, la verdadera innovación.