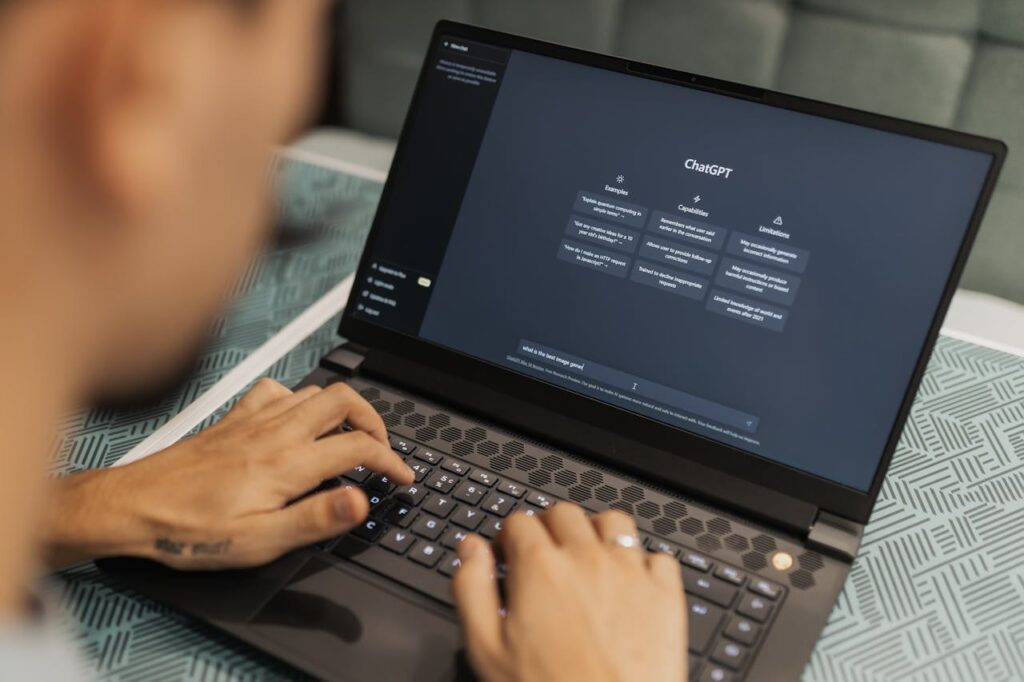

La conversación sobre inteligencia artificial y contenidos digitales ha entrado en una nueva etapa. En un momento en el que la automatización avanza con rapidez, la mayor enciclopedia colaborativa del mundo decidió trazar una línea clara: limitar el uso de herramientas generativas en la construcción de conocimiento público. La medida no solo impacta a editores y comunidades digitales, también abre preguntas sobre transparencia, confianza y gobernanza tecnológica.

Para quienes observan el fenómeno desde la responsabilidad social, la decisión de la plataforma representa algo más que una norma editorial. Es, en esencia, un posicionamiento frente al uso de tecnología en espacios donde la veracidad y la trazabilidad son fundamentales.

El debate sobre los artículos con IA deja de ser únicamente técnico y se convierte en una discusión sobre ética digital, participación comunitaria y calidad de la información.

El debate detrás de los artículos con IA

Durante los últimos años, los asistentes basados en grandes modelos de lenguaje comenzaron a incorporarse a distintas tareas editoriales en internet. Desde resúmenes hasta redacción completa, la promesa de velocidad y eficiencia atrajo a miles de usuarios. Sin embargo, en el ecosistema de Wikipedia —donde cada afirmación debe estar respaldada por fuentes verificables— esta tendencia encendió alertas.

De acuerdo con lo discutido dentro de la comunidad de editores, herramientas como las utilizadas para generar artículos con IA pueden modificar conceptos clave o reinterpretar información que originalmente estaba sustentada por referencias. Este fenómeno, aparentemente menor, tiene un impacto directo en la confiabilidad de una plataforma que millones de personas consultan a diario.

La preocupación principal radica en que, incluso cuando el texto generado parece correcto, pequeñas variaciones pueden alterar el sentido original de los contenidos. En un entorno colaborativo, donde la precisión es un principio básico, este tipo de alteraciones puede afectar la integridad del conocimiento compartido.

Artículos con IA: dónde se establecen los límites

La nueva normativa establece una prohibición clara: la inteligencia artificial generativa no debe utilizarse para redactar o editar entradas dentro de la enciclopedia. La razón central es que estas herramientas pueden contravenir varias de las políticas esenciales que regulan la creación de contenido dentro de la plataforma.

Uno de los riesgos señalados por la comunidad es que los sistemas automatizados pueden introducir cambios que no están respaldados por las fuentes originales citadas en un artículo. En otras palabras, aunque la modificación parezca mínima, puede romper la coherencia entre la información publicada y la evidencia que la sustenta.

Esta medida marca un precedente importante en el debate global sobre la automatización del conocimiento. En un entorno donde la velocidad digital suele imponerse, Wikipedia decidió priorizar la verificación humana y la responsabilidad editorial.

Las excepciones permitidas para la inteligencia artificial

A pesar de la restricción, la plataforma no ha descartado completamente el uso de inteligencia artificial. La comunidad estableció dos escenarios en los que la tecnología puede ser útil sin comprometer la integridad del contenido: la corrección ortográfica y gramatical, así como la traducción de artículos a otros idiomas.

Sin embargo, incluso en estos casos, el uso de herramientas automatizadas debe estar estrictamente supervisado por editores humanos. La condición principal es que la IA no agregue contenido nuevo ni altere el significado original de los textos. En esencia, se trata de una asistencia técnica y no de una participación editorial.

Este matiz es clave para entender la postura de la plataforma. No se trata de rechazar la innovación, sino de delimitar su papel dentro de un ecosistema basado en la colaboración y la confianza.

El papel de la supervisión humana

Uno de los puntos que más enfatizó la comunidad es la necesidad de mantener el control humano sobre cada cambio sugerido por sistemas automatizados. Incluso cuando la inteligencia artificial se usa para tareas simples, existe el riesgo de que el sistema vaya más allá de lo solicitado.

Por ello, la revisión manual se vuelve un elemento central del proceso editorial. Los editores deben verificar que cada ajuste propuesto respete el sentido del texto original y no modifique información clave. En el caso de las traducciones, la supervisión es aún más estricta. La comunidad exige que el resultado final sea revisado completamente antes de su publicación, asegurando que cualquier posible alteración conceptual sea corregida a tiempo.

Una decisión impulsada desde la comunidad

La iniciativa que llevó a esta medida fue impulsada por una administradora de la plataforma conocida como Chaotic Enby, quien planteó la necesidad de debatir el alcance de la inteligencia artificial dentro de los procesos editoriales. Más allá de la normativa en sí, el planteamiento abrió una discusión más amplia: quién debe decidir cómo se integra la tecnología en plataformas colaborativas. En este caso, la respuesta fue clara: la comunidad.

La expectativa de quienes promovieron la propuesta es que otras plataformas digitales puedan observar este proceso y replantear sus propias políticas sobre automatización y contenidos.

La decisión llega en un momento en el que el uso de inteligencia artificial para producir contenidos digitales crece de forma acelerada. Desde redes sociales hasta portales informativos, la presencia de sistemas automatizados es cada vez más común. En este contexto, la postura de Wikipedia busca reforzar la confianza en su modelo colaborativo. Al limitar la generación automática de contenido, la plataforma intenta proteger la calidad de la información y la transparencia en su construcción.

Para muchos analistas del ecosistema digital, este movimiento también refleja una preocupación más amplia: cómo garantizar la integridad del conocimiento cuando la producción de textos puede automatizarse a gran escala.

La restricción sobre los artículos con IA no solo redefine la forma en que se construyen las entradas dentro de Wikipedia. También envía un mensaje al resto del ecosistema digital: la innovación tecnológica necesita reglas claras cuando se trata de información pública y verificada.

En un entorno donde la velocidad de producción de contenidos crece constantemente, la apuesta por la supervisión humana y la responsabilidad editorial podría convertirse en un referente para otras comunidades digitales. Más que una batalla ganada o perdida, la decisión abre un nuevo capítulo en la conversación sobre cómo equilibrar tecnología, confianza y conocimiento compartido.